bp神经网络代码案例(bp神经网络实例分析)

admin 发布:2022-12-19 21:04 133

今天给各位分享bp神经网络代码案例的知识,其中也会对bp神经网络实例分析进行解释,如果能碰巧解决你现在面临的问题,别忘了关注本站,现在开始吧!

本文目录一览:

- 1、求大神解读一下matlab代码。bp神经网络NEWff部分。

- 2、BP神经网络matlab源程序代码讲解

- 3、求预测一组数据的bp神经网络模型的matlab代码

- 4、BP神经网络matlab代码

- 5、求基于BP神经网络的图像复原算法的matlab代码

- 6、急求BP神经网络算法,用java实现!!!

求大神解读一下matlab代码。bp神经网络NEWff部分。

newff建立一个bp神经网络模型,threshold应该是输入,决定输入层数目,20个隐含层,四个输出层,tansig是隐含层函数,logsig是输出层函数,trainlm是训练方法,Levenberg-Marquardt BP训练函数。

epochs是设置最大迭代次数,goal是设置期望误差,就是训练到最后希望误差小到什么程度,这里的误差默认是mse误差。

LP是啥?定义的网络不是net咩??反正后面的lr是学习速率。

最后一句是在训练网络。

可以参考下这个博客!!里面举了个例子,注释也比较清楚。

BP神经网络matlab源程序代码讲解

newff 创建前向BP网络格式:

net = newff(PR,[S1 S2...SNl],{TF1 TF2...TFNl},BTF,BLF,PF)

其中:PR —— R维输入元素的R×2阶最大最小值矩阵; Si —— 第i层神经元的个数,共N1层; TFi——第i层的转移函数,默认‘tansig’; BTF—— BP网络的训练函数,默认‘trainlm’; BLF—— BP权值/偏差学习函数,默认’learngdm’ PF ——性能函数,默认‘mse’;(误差)

e.g.

P = [0 1 2 3 4 5 6 7 8 9 10];T = [0 1 2 3 4 3 2 1 2 3 4];

net = newff([0 10],[5 1],{'tansig' 'purelin'});net.trainparam.show=50; %每次循环50次net.trainParam.epochs = 500; %最大循环500次

net.trainparam.goal=0.01; %期望目标误差最小值

net = train(net,P,T); %对网络进行反复训练

Y = sim(net,P)Figure % 打开另外一个图形窗口

plot(P,T,P,Y,'o')

求预测一组数据的bp神经网络模型的matlab代码

用matlab求预测一组数据的bp神经网络模型,可以分

1、给定已经数据,作为一个原始序列;

2、设定自回归阶数,一般2~3,太高不一定好;

3、设定预测某一时间段

4、设定预测步数

5、用BP自定义函数进行预测

6、根据预测值,用plot函数绘制预测数据走势图

其主要实现代码如下:

clc

% x为原始序列(行向量)

x=[208.72 205.69 231.5 242.78 235.64 218.41];

%x=[101.4 101.4 101.9 102.4 101.9 102.9];

%x=[140 137 112 125 213 437.43];

t=1:length(x);

% 自回归阶数

lag=3;

%预测某一时间段

t1=t(end)+1:t(end)+5;

%预测步数为fn

fn=length(t1);

[f_out,iinput]=BP(x,lag,fn);

P=vpa(f_out,5);

A=[t1' P'];

disp('预测值')

disp(A)

% 画出预测图

figure(1),plot(t,iinput,'bo-'),hold on

plot(t(end):t1(end),[iinput(end),f_out],'rp-'),grid on

title('BP神经网络预测某地铁线路客流量')

xlabel('月号'),ylabel('客流量(百万)');

运行结果:

BP神经网络matlab代码

clear

clc

alpha=0.05;

eta=0.2;

ny=2;d=2;nu=3;

n=ny+nu-d+1;

m=6;

w1k1=randn(m,n);%6*4

w1k2=w1k1;

w2k1=randn(1,m);%1*6

w2k2=w2k1;

L=1000;

uk=zeros(nu,1);%2*1

yk=zeros(ny,1);%2*1

fork=1:L

time(k)=k;

u(k)=0.8*sin(0.01*pi*k);

y(k)=uk(2)^3+uk(3)^3+(0.8+yk(1)^3)/(1+yk(1)^2+yk(2)^4);

X=[yk;uk(d:nu)];

o=X;%4*1

net2=w1k1*X;% 6*1

o2=1./(1+exp(-net2));%6*1

ym(k)=w2k1*o2;

e(k)=y(k)-ym(k);

dw2=eta*e(k)*o2';%1*6 e(k)ÊÇÒ»¸öÊý£¬kָϱꡣ

w2=w2k1+dw2+alpha*(w2k1-w2k2);%1*6

dnet2=exp(-net2)./(1+exp(-net2)).^2;%6*1

dw1k1=eta*e(k)*w2k1'.*dnet2*o';

w1=w1k1+dw1k1+alpha*(w1k1-w1k2);

w1k2=w1k1;w1k1=w1;

w2k2=w2k1;w2k1=w2;

for i=nu:-1:2

uk(i)=uk(i-1);

end

uk(1)=u(k);

for i=ny:-1:2

yk(i)=yk(i-1);

end

yk(1)=y(k);

end

subplot(211)

plot(time,y,'r:',time,ym,'k');

xlabel('k'); ylabel('y(k)¡¢y_m(k)');

legend('y(k)','y_m(k)'); %axis([0 L -.4 1.6]);

subplot(212)

plot(time,y-ym,'k');

xlabel('k'); ylabel('e(k)'); axis([0 L -1 1]);

求基于BP神经网络的图像复原算法的matlab代码

function Solar_SAE

tic;

n = 300;

m=20;

train_x = [];

test_x = [];

for i = 1:n

%filename = strcat(['D:\Program Files\MATLAB\R2012a\work\DeepLearn\Solar_SAE\64_64_3train\' num2str(i,'%03d') '.bmp']);

%filename = strcat(['E:\matlab\work\c0\TrainImage' num2str(i,'%03d') '.bmp']);

filename = strcat(['E:\image restoration\3-(' num2str(i) ')-4.jpg']);

b = imread(filename);

%c = rgb2gray(b);

c=b;

[ImageRow ImageCol] = size(c);

c = reshape(c,[1,ImageRow*ImageCol]);

train_x = [train_x;c];

end

for i = 1:m

%filename = strcat(['D:\Program Files\MATLAB\R2012a\work\DeepLearn\Solar_SAE\64_64_3test\' num2str(i,'%03d') '.bmp']);

%filename = strcat(['E:\matlab\work\c0\TestImage' num2str(i+100,'%03d') '-1.bmp']);

filename = strcat(['E:\image restoration\3-(' num2str(i+100) ').jpg']);

b = imread(filename);

%c = rgb2gray(b);

c=b;

[ImageRow ImageCol] = size(c);

c = reshape(c,[1,ImageRow*ImageCol]);

test_x = [test_x;c];

end

train_x = double(train_x)/255;

test_x = double(test_x)/255;

%train_y = double(train_y);

%test_y = double(test_y);

% Setup and train a stacked denoising autoencoder (SDAE)

rng(0);

%sae = saesetup([4096 500 200 50]);

%sae.ae{1}.activation_function = 'sigm';

%sae.ae{1}.learningRate = 0.5;

%sae.ae{1}.inputZeroMaskedFraction = 0.0;

%sae.ae{2}.activation_function = 'sigm';

%sae.ae{2}.learningRate = 0.5

%%sae.ae{2}.inputZeroMaskedFraction = 0.0;

%sae.ae{3}.activation_function = 'sigm';

%sae.ae{3}.learningRate = 0.5;

%sae.ae{3}.inputZeroMaskedFraction = 0.0;

%sae.ae{4}.activation_function = 'sigm';

%sae.ae{4}.learningRate = 0.5;

%sae.ae{4}.inputZeroMaskedFraction = 0.0;

%opts.numepochs = 10;

%opts.batchsize = 50;

%sae = saetrain(sae, train_x, opts);

%visualize(sae.ae{1}.W{1}(:,2:end)');

% Use the SDAE to initialize a FFNN

nn = nnsetup([4096 1500 500 200 50 200 500 1500 4096]);

nn.activation_function = 'sigm';

nn.learningRate = 0.03;

nn.output = 'linear'; % output unit 'sigm' (=logistic), 'softmax' and 'linear'

%add pretrained weights

%nn.W{1} = sae.ae{1}.W{1};

%nn.W{2} = sae.ae{2}.W{1};

%nn.W{3} = sae.ae{3}.W{1};

%nn.W{4} = sae.ae{3}.W{2};

%nn.W{5} = sae.ae{2}.W{2};

%nn.W{6} = sae.ae{1}.W{2};

%nn.W{7} = sae.ae{2}.W{2};

%nn.W{8} = sae.ae{1}.W{2};

% Train the FFNN

opts.numepochs = 30;

opts.batchsize = 150;

tx = test_x(14,:);

nn1 = nnff(nn,tx,tx);

ty1 = reshape(nn1.a{9},64,64);

nn = nntrain(nn, train_x, train_x, opts);

toc;

tic;

nn2 = nnff(nn,tx,tx);

toc;

tic;

ty2 = reshape(nn2.a{9},64,64);

tx = reshape(tx,64,64);

tz = tx - ty2;

tz = im2bw(tz,0.1);

%imshow(tx);

%figure,imshow(ty2);

%figure,imshow(tz);

ty = cat(2,tx,ty2,tz);

montage(ty);

filename3 = strcat(['E:\image restoration\3.jpg']);

e=imread(filename3);

f= rgb2gray(e);

f=imresize(f,[64,64]);

%imshow(ty2);

f=double (f)/255;

[PSNR, MSE] = psnr(ty2,f)

imwrite(ty2,'E:\image restoration\bptest.jpg','jpg');

toc;

%visualize(ty);

%[er, bad] = nntest(nn, tx, tx);

%assert(er 0.1, 'Too big error');

急求BP神经网络算法,用java实现!!!

见附件,一个基本的用java编写的BP网络代码。

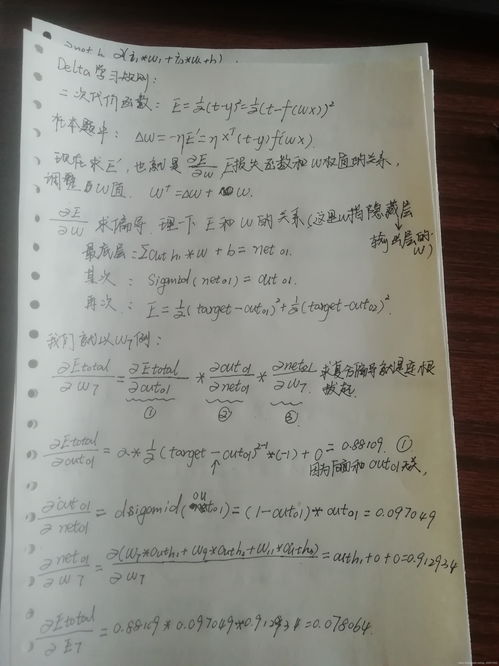

BP(Back Propagation)神经网络是86年由Rumelhart和McCelland为首的科学家小组提出,是一种按误差逆传播算法训练的多层前馈网络,是目前应用最广泛的神经网络模型之一。BP网络能学习和存贮大量的输入-输出模式映射关系,而无需事前揭示描述这种映射关系的数学方程。它的学习规则是使用最速下降法,通过反向传播来不断调整网络的权值和阈值,使网络的误差平方和最小。BP神经网络模型拓扑结构包括输入层(input)、隐层(hidden layer)和输出层(output layer)。

bp神经网络代码案例的介绍就聊到这里吧,感谢你花时间阅读本站内容,更多关于bp神经网络实例分析、bp神经网络代码案例的信息别忘了在本站进行查找喔。

版权说明:如非注明,本站文章均为 AH站长 原创,转载请注明出处和附带本文链接;

- 上一篇:织梦开源代码(织梦开发教程)

- 下一篇:飞鸽传书源代码vc(飞鸽传书起源)

相关推荐

- 05-09网页代码,网页代码快捷键

- 05-06单页网站的代码(完整的网页代码)[20240506更新]

- 05-06个人主页图片代码(个人主页图片代码怎么弄)[20240506更新]

- 05-06提取微信名片代码(微信名片信息提取)[20240506更新]

- 05-06php后台权限管理代码(php管理员权限)[20240506更新]

- 05-06付费观看代码php(付费观看代码)[20240506更新]

- 05-06在线html执行代码(html怎么运行)[20240506更新]

- 05-06源代码管理资源管理器(资源管理器运行代码)[20240506更新]

- 05-06代码源软件库(程序代码库)[20240506更新]

- 05-06点击弹出密码代码(点击弹出密码代码错误)[20240506更新]

取消回复欢迎 你 发表评论:

- 标签列表

- 最近发表

- 友情链接